摘 要:本文旨在探讨量子计算与人工智能融合条件下加密系统面临的结构性挑战,构建具备抗量子能力的算法模型与协议框架。研究从密钥生成路径重构与通信协议逻辑强化入手,设计AI驱动的自适应加密机制与多层认证结构。结果表明核心机制在高干扰环境下保持稳定匹配率与低延迟响应,展现出较强的结构稳健性。该研究为未来信息系统的密码架构演进提供了可迁移的技术支点与体系建构思路。

关键词:量子计算;人工智能;加密算法;通信安全

1 引言

量子计算(Quantum Computing,QC),是一种遵循量子力学规律调控量子信息单元进行计算的新型计算模式。量子计算对非对称密码结构的解构能力与人工智能对攻击行为的识别适应能力在算法层面引发了安全逻辑的系统重构,信息系统中原有依赖数学难题构建的加密信任机制在高性能量子处理器面前逐步失效,密钥生成路径、传输协议结构与身份验证流程需在算法体系与实现路径上形成协同演进,技术融合已不再是并置关系而是体系性依赖,安全模型的更新不应停留在算力对抗层面,而需在结构重塑中形成通感、自治与抗推演的自洽闭环。

2 量子冲击分析

2.1 公钥结构失效机制

公钥加密体系的安全性主要依赖于大数分解、离散对数等数学难题在传统计算机上具备超指数级的计算复杂度。然而在量子计算条件下,这一基础遭遇根本性破坏。以RSA为例,其安全性依赖模数![]() 的因式分解难度。在经典计算模式下,分解长度为n位的模数所需时间复杂度近似为亚指数级;而Shor算法可以在量子位操作下将该问题压缩至多项式时间,即

的因式分解难度。在经典计算模式下,分解长度为n位的模数所需时间复杂度近似为亚指数级;而Shor算法可以在量子位操作下将该问题压缩至多项式时间,即![]() 。其中运算单位为量子门操作次数,

。其中运算单位为量子门操作次数,![]() 表示模数

表示模数![]() 的比特长度。直观理解是:原本需要耗费数十亿年才能完成的分解任务,在量子条件下仅需与密钥位长三次方成比例的操作量即可完成。以2048位RSA密钥为例,经典算法在现有算力下几乎无法完成分解,而量子算法理论上只需约20483 量级的门操作即可恢复私钥。该突破意味着RSA赖以生存的“指数级计算壁垒”不复存在,椭圆曲线密码体系依托的离散对数问题也同样失效[1]。在此背景下,密钥协商、数字签名和身份认证等模块的不可逆性与防伪性将被完全破坏,端到端传输链路暴露于量子攻击路径之下。若硬件安全模块继续调用非对称计算接口,其加密运算等同于明文传输,无法再构成有效的密钥管理和访问隔离边界

的比特长度。直观理解是:原本需要耗费数十亿年才能完成的分解任务,在量子条件下仅需与密钥位长三次方成比例的操作量即可完成。以2048位RSA密钥为例,经典算法在现有算力下几乎无法完成分解,而量子算法理论上只需约20483 量级的门操作即可恢复私钥。该突破意味着RSA赖以生存的“指数级计算壁垒”不复存在,椭圆曲线密码体系依托的离散对数问题也同样失效[1]。在此背景下,密钥协商、数字签名和身份认证等模块的不可逆性与防伪性将被完全破坏,端到端传输链路暴露于量子攻击路径之下。若硬件安全模块继续调用非对称计算接口,其加密运算等同于明文传输,无法再构成有效的密钥管理和访问隔离边界

2.2 数据传输安全漏洞

量子计算对通信协议的威胁不仅限于密钥破解,还体现在协议流程逻辑上的结构性脆弱性。以Diffie-Hellman类协商为例,其核心依赖于素数域乘法群或椭圆曲线点集上的离散对数难题,而在量子环境下此类问题可被多项式时间算法求解。攻击者若在链路上被动拦截交换参数,即可利用量子处理器的全域映射能力快速恢复协商密钥,从而重建完整的会话结构。与此同时,协议中广泛应用的消息认证码(MAC)和哈希函数在Grover搜索或量子幅度放大算法下,碰撞概率和逆向推演效率显著提升,其原本依赖压缩映射的安全性将遭受削弱。若伪随机数种子未引入量子扰动,其状态序列会呈现周期收敛,导致密钥更新周期缩短与信道抗重放能力下降[2]。

3 AI加密算法设计

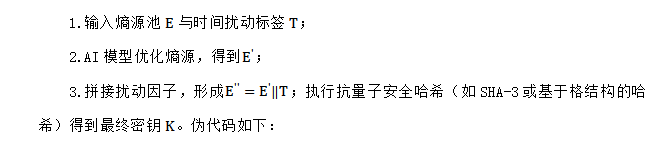

3.1 密钥生成自适应化

在量子环境下,密钥生成必须避免固定规则带来的可预测性,提升熵源的复杂性和动态演化能力。AI模型在该过程中承担熵分布优化与随机性评估的双重角色。具体而言,密钥生成机制基于强化学习 + 神经网络:强化学习框架通过奖励函数引导网络逐轮优化熵源分布,奖励函数由两部分构成:

![]()

其中![]() 表示优化后熵源的香农熵,

表示优化后熵源的香农熵,![]() 表示预测可预测度,

表示预测可预测度,![]() 为权重因子。该设计确保模型在最大化随机性的同时,抑制模式化趋势。神经网络采用三层结构:输入层接收异构特征(如硬件噪声、时序抖动、传感器采样),隐藏层通过ReLU和tanh组合实现非线性映射,输出层生成候选熵块。AI模型在每一轮迭代后执行统计分布校验,如卡方检验和NIST随机性测试,并将结果反馈给强化学习代理,驱动参数更新。最终的密钥生成过程可表示为:

为权重因子。该设计确保模型在最大化随机性的同时,抑制模式化趋势。神经网络采用三层结构:输入层接收异构特征(如硬件噪声、时序抖动、传感器采样),隐藏层通过ReLU和tanh组合实现非线性映射,输出层生成候选熵块。AI模型在每一轮迭代后执行统计分布校验,如卡方检验和NIST随机性测试,并将结果反馈给强化学习代理,驱动参数更新。最终的密钥生成过程可表示为:

这种基于AI自适应优化的密钥生成机制,相比传统规则化方法,具备更高的熵复杂度、更低的可预测性与抗量子推演能力,从而保证了量子条件下密钥空间的独立性与安全性[3]。

3.2 攻击行为建模防护

AI在攻击检测中的功能不仅是静态规则匹配,更需扩展至攻击链路径建模与潜在行为预测,模型的输入为通信流量特征、节点访问序列与异常时序数据,输出为风险预测值![]() ,训练过程中采用稀疏注意力机制增强对时序依赖的捕捉能力,结合反向传播扰动提高模型对对抗样本的鲁棒性,在识别阶段模型对异常行为的时间演化与空间聚集特征进行动态评估,并通过最小监督方式完成攻击路径收敛性分析,检测误差由置信阈值模块缓冲,当预测精度下降时自动压缩推理空间,确保在复杂场景下仍维持可控的误报率。与密钥生成和协议执行的衔接主要体现在风险驱动的自适应调整机制,当

,训练过程中采用稀疏注意力机制增强对时序依赖的捕捉能力,结合反向传播扰动提高模型对对抗样本的鲁棒性,在识别阶段模型对异常行为的时间演化与空间聚集特征进行动态评估,并通过最小监督方式完成攻击路径收敛性分析,检测误差由置信阈值模块缓冲,当预测精度下降时自动压缩推理空间,确保在复杂场景下仍维持可控的误报率。与密钥生成和协议执行的衔接主要体现在风险驱动的自适应调整机制,当![]() 超过预设阈值时系统触发密钥更新事件,调用AI自适应密钥生成模块重构新的会话密钥,并引入时间扰动因子缩短密钥生命周期,防止已暴露的随机序列被量子攻击逆推,在协议层风险值被写入通信上下文作为安全标签,用于调整认证阈值与多重签名机制的启用条件,例如在低风险状态下执行单重身份验证,而在高风险状态下自动升级为基于格签名与零知识证明的双层验证。

超过预设阈值时系统触发密钥更新事件,调用AI自适应密钥生成模块重构新的会话密钥,并引入时间扰动因子缩短密钥生命周期,防止已暴露的随机序列被量子攻击逆推,在协议层风险值被写入通信上下文作为安全标签,用于调整认证阈值与多重签名机制的启用条件,例如在低风险状态下执行单重身份验证,而在高风险状态下自动升级为基于格签名与零知识证明的双层验证。

4 协议系统实现

协议系统需同时具备量子抗性和自适应特征,其核心目标是保证身份认证与链路加密在量子攻击环境下仍保持不可逆性与独立性。量子抗性签名方案可优先选用基于格密码的Dilithium或哈希签名方案SPHINCS+,两者已进入NIST抗量子密码标准化流程,具有较强的数学安全基础与实现可行性。零知识证明结构建议采用zk-SNARKs或基于哈希承诺的轻量化方案,以降低计算负担并保持协议交互效率。事件触发型密钥更新机制需由AI攻击行为模型的风险预测值驱动,当风险值![]() 超过预设阈值、或链路监测到认证错误率快速上升、抖动/延迟显著异常时,立即触发密钥重协商,缩短密钥生命周期,避免重放窗口暴露。

超过预设阈值、或链路监测到认证错误率快速上升、抖动/延迟显著异常时,立即触发密钥重协商,缩短密钥生命周期,避免重放窗口暴露。

4.1 身份验证流程部署

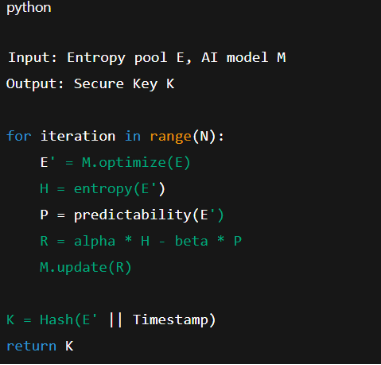

身份验证协议在信息交换前完成握手初始化、身份生成与密钥验证三个阶段,形成完整的抗量子认证链。握手阶段结合基于格的公钥挑战与动态时间戳扰动,并利用短周期哈希更新函数生成不可预测的临时标识码。身份生成阶段采用Dilithium签名确保抗量子伪造能力,同时嵌入双向可信承诺机制实现双向认证。AI模型在认证过程中实时提取流量特征,动态调整置信阈值,以抑制异常行为带来的误判。信息回传阶段,密钥一致性验证由多模态反馈机制完成,例如同时验证信号强度预测与签名完整性,提升抗干扰能力。表1显示在不同干扰条件下的性能指标,验证了该方案在高噪声环境下仍保持较高的匹配率和可接受的延迟,但在40 dB以上干扰下性能下降,表明协议在极端条件下仍需优化。

表1:不同干扰条件下身份验证流程的性能指标对比

认证性能在低至中等干扰下保持高匹配率与低延迟状态,匹配率下降与错误接受率增长主要在40dB以上干扰环境下出现,说明协议结构对抗高噪通道下的稳定性与自适应判断能力仍具优化空间。

4.2 通信链路加密构建

链路加密采用双栈模型,入口阶段引入零知识证明构建非明文认证通道,避免协商参数被量子逆推;中间阶段结合多轮协商与扰动机制,使会话密钥在周期内不断变化,降低静态窃听成功率;加密路径中嵌入对称密钥算法与量子安全密钥分发(QKD)混合模式,并通过误差校正和扰动同步维持稳定性。事件触发的密钥更新策略确保在检测到攻击风险、认证异常或链路波动时自动更新密钥,而非依赖固定周期,从而压缩攻击窗口。链路内部嵌入基于哈希的抗量子碰撞压缩函数,保证认证回执的一致性和路径溯源。链路末端则设置冗余比特校验和信号门限模块,用于抵御突发干扰下的压缩泄露,最终实现动态密钥嵌套与周期性验证的组合,确保通信在量子威胁下的不可逆性与实体间的独立信道。

5 结论

本文在量子计算与人工智能融合背景下,针对公钥失效与通信协议漏洞等问题,提出了AI驱动的加密防护机制。研究构建了基于强化学习的自适应密钥生成方法,引入熵优化与时间扰动提升随机性;建立了攻击行为建模框架,将风险预测值与密钥更新、协议调整联动,实现检测与防御闭环;设计了融合格密码签名、零知识证明与事件触发更新机制的抗量子协议体系,并在仿真中验证了高干扰环境下的稳定性。与现有研究相比,本文强调AI在自适应优化与动态防御中的作用,提出“量子抗性原语+AI驱动”的双层思路。局限在于实验环境受限,未来需结合标准化格密码与QKD链路进一步验证工程可行性。

参考文献

[1]石子率. 新型加密算法在网络信息传输中的应用[J].通讯世界,2025,32(06):55-57.

[2]张尚哲. 基于量子计算的加密方法及抗量子攻击算法的理论研究[J].网络安全技术与应用,2025,(04):56-58.

[3]陈发堂,郑金贵,陈峰,等. 基于PID控制的自适应密钥生成[J].南京邮电大学学报(自然科学版),2023,43(03):11-18.